近日,機(jī)電設(shè)計(jì)與知識(shí)工程研究所胡潔教授、戚進(jìn)副研究員團(tuán)隊(duì)提出一種融合混合現(xiàn)實(shí)(MR)與生成式AI的人機(jī)技能遷移框架,為工業(yè)場景下的精準(zhǔn)人機(jī)協(xié)作提供了創(chuàng)新性解決方案。研究成果“A mixed reality-assisted human-to-robot skill transfer approach for contact-rich assembly via visuomotor primitives”發(fā)表在Robotics and Computer-Integrated Manufacturing上。博士生武對(duì)娣、趙乾佑為共同第一作者,香港理工大學(xué)鄭湃教授為共同作者,胡潔教授、戚進(jìn)副研究員為通訊作者。

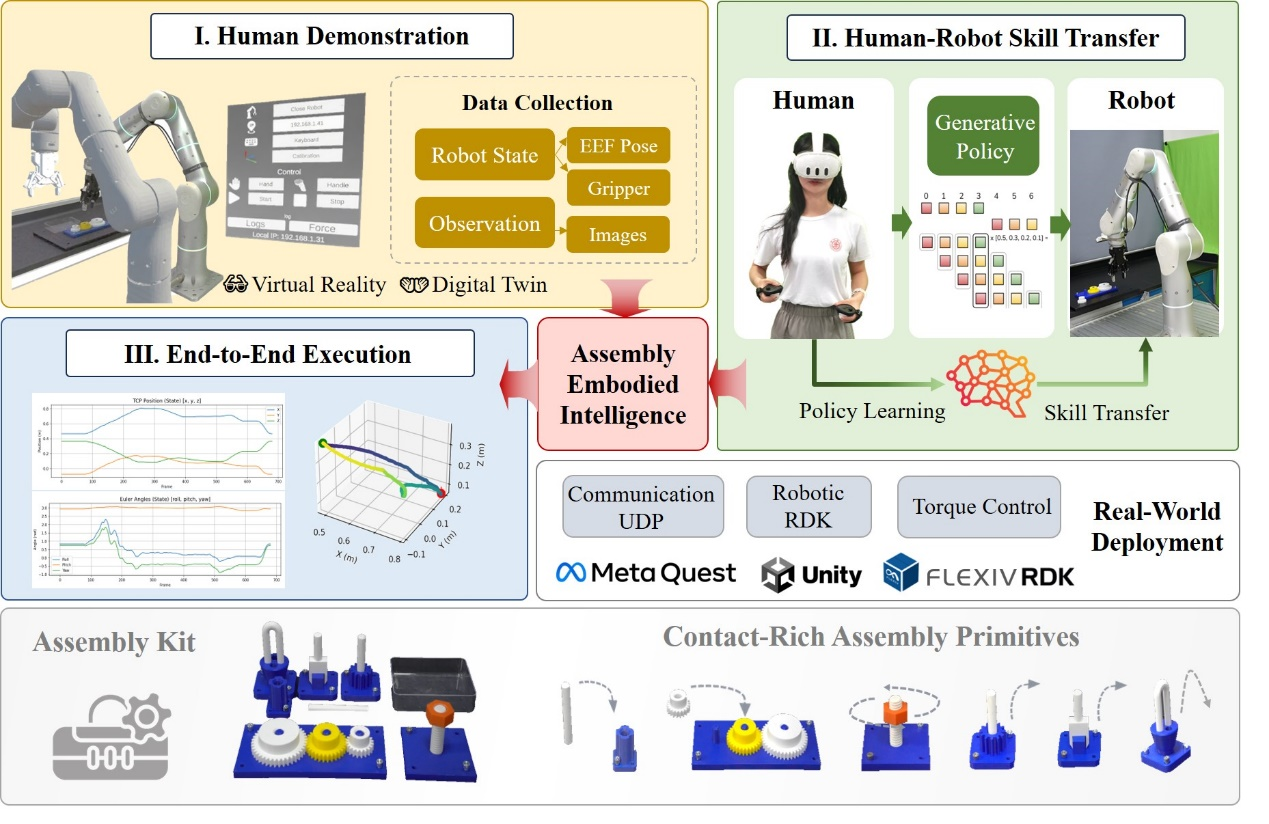

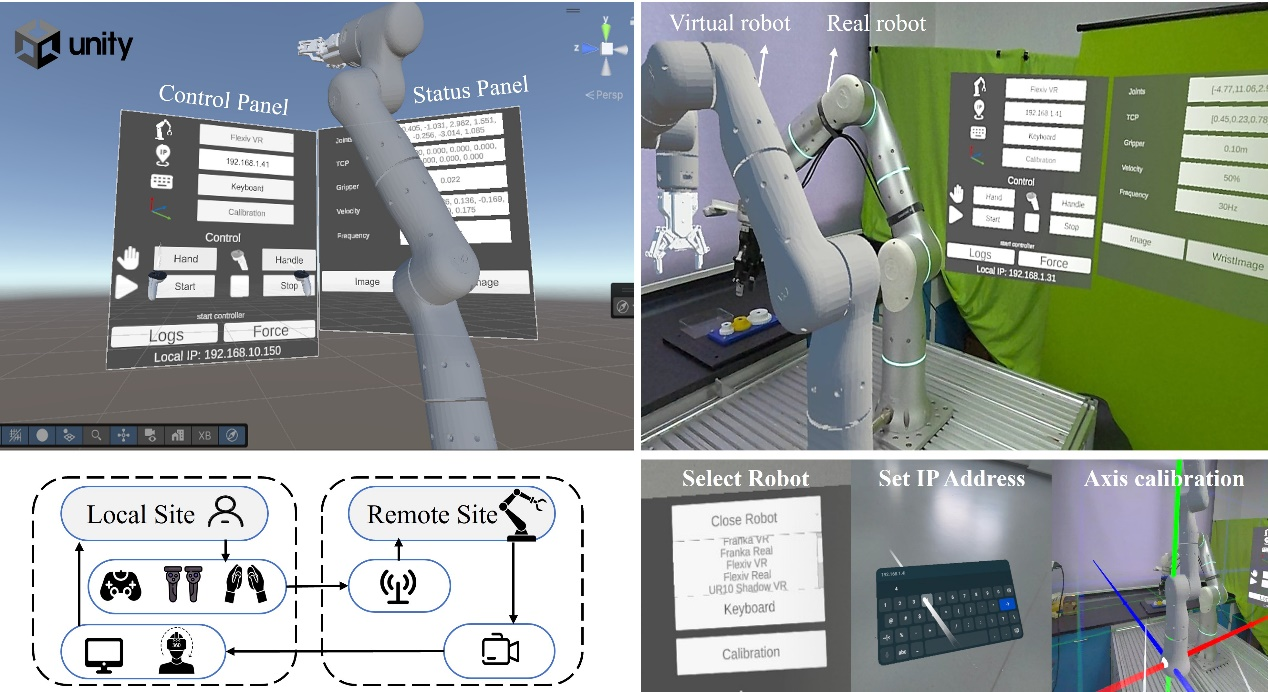

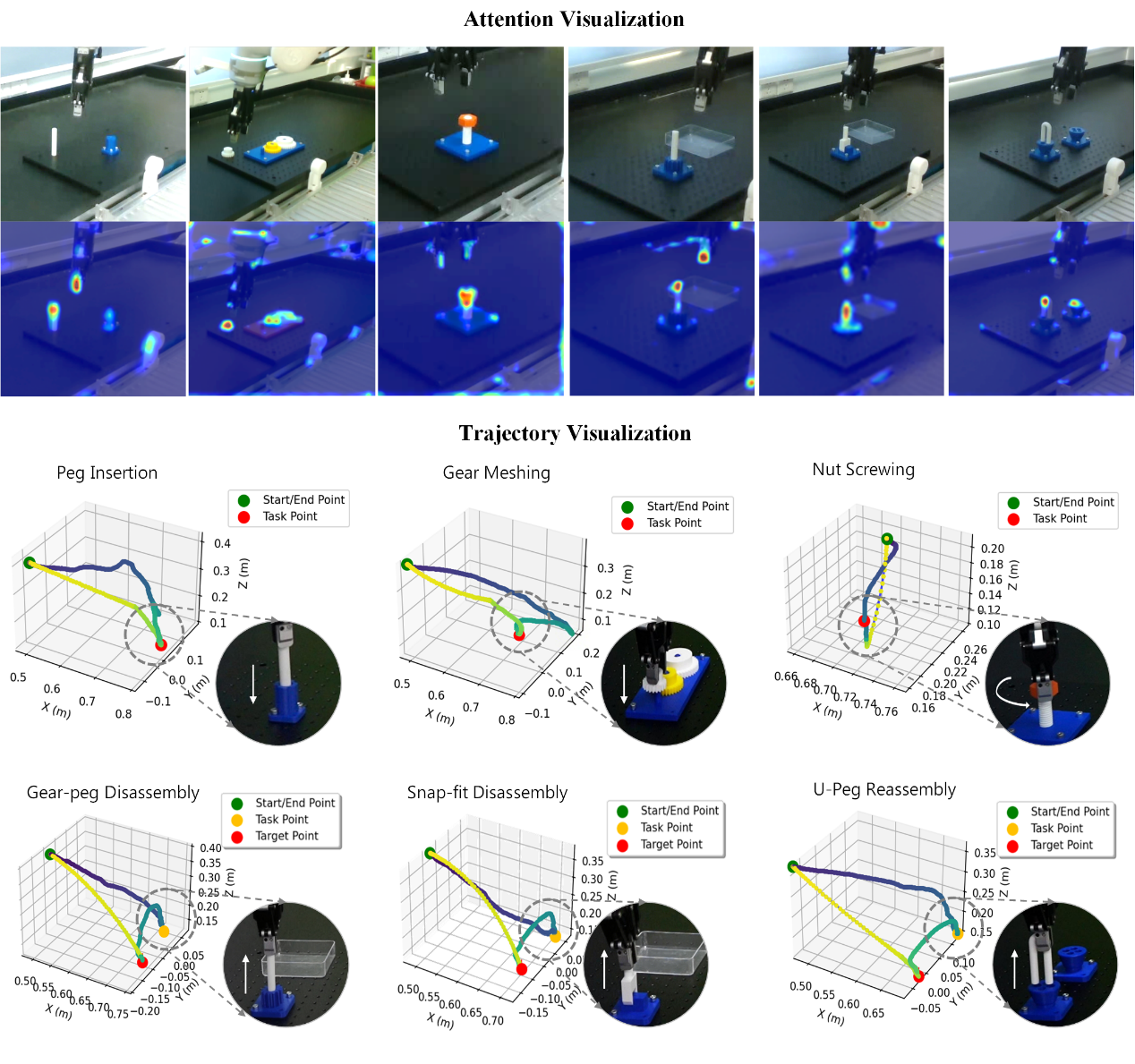

在智能制造向柔性化、智能化轉(zhuǎn)型的背景下,接觸豐富型裝配任務(wù)因高精密、強(qiáng)耦合的操作要求,成為機(jī)器人技術(shù)落地的核心瓶頸。當(dāng)前具身智能研究多聚焦日常任務(wù),工業(yè)級(jí)精密操作泛化能力不足,對(duì)此研究構(gòu)建了“數(shù)據(jù)采集—技能學(xué)習(xí)—精準(zhǔn)執(zhí)行”的閉環(huán)體系。研究基于MR設(shè)備和Unity開發(fā)數(shù)字孿生演示系統(tǒng),搭建低成本、沉浸式人機(jī)交互界面,支持位置控制與速度控制雙模式操作,實(shí)現(xiàn)跨機(jī)器人平臺(tái)的靈活數(shù)據(jù)采集;建立了包含插銷裝配、齒輪嚙合、螺母緊固等6類工業(yè)典型任務(wù)的基準(zhǔn)數(shù)據(jù)集;提出端到端生成式視覺—運(yùn)動(dòng)模仿學(xué)習(xí)策略,直接從多視角視覺與機(jī)器人狀態(tài)數(shù)據(jù)中學(xué)習(xí)連續(xù)動(dòng)作序列,有效降低軌跡漂移與誤差累積,保障精密操作的安全與準(zhǔn)確性。

實(shí)驗(yàn)驗(yàn)證顯示,該框架在隨機(jī)擾動(dòng)、復(fù)雜接觸約束場景下仍保持高成功率,在各個(gè)裝配任務(wù)上展現(xiàn)出優(yōu)異的位置泛化能力。相較于傳統(tǒng)軌跡規(guī)劃與單步模仿學(xué)習(xí)方法,該方案無需復(fù)雜仿真訓(xùn)練與傳感器標(biāo)定,可實(shí)現(xiàn)人類裝配技能向機(jī)器人的高效遷移,大幅提升了工業(yè)機(jī)器人對(duì)非結(jié)構(gòu)化環(huán)境的適應(yīng)能力。

該研究為生成式AI與物理智能的深度融合提供了關(guān)鍵技術(shù)支撐,其低成本部署特性與靈活適配能力有望推動(dòng)人機(jī)協(xié)作技術(shù)在汽車制造、精密電子等領(lǐng)域的工程應(yīng)用,為智能工廠的柔性生產(chǎn)轉(zhuǎn)型注入新動(dòng)能。

研究工作得到了國家自然科學(xué)基金、香港理工大學(xué)聯(lián)合導(dǎo)師計(jì)劃等項(xiàng)目的支持。

論文鏈接:https://doi.org/10.1016/j.rcim.2025.103208

項(xiàng)目網(wǎng)站:https://h2r-mrsta.github.io/